Der Microsoft Hyper-V Server 2008 R2 ist für mich einen faszinierende komplett Version des Microsoft Windows Server 2008 R2. Mit Ihm kann man einem der Enterprise Version in nichts nachstehenden, 16 Knoten umfassenden Cluster incl. der begehrten Livemigration aufbauen. Und das Beste: für sage und schreibe 0 Euro! Richtig er kostet nichts! Aber warum wird der Hyper-V Server 2008 R2 dann so selten eingesetzt?

Meiner Meinung nach hat das drei Gründe:

- Ganz einfach – viele kennen diese Variante der Windows Server 2008 R2 schlicht und ergreifend nicht.

- Windows Administratoren haben die grafischen Tools von Windows schätzen und lieben gelernt. Deswegen mögen Sie ein System mit einer so minimalistischen Oberfläche nicht.

- Wer sich dann mit dem Hyper-V Server 2008 R2 beschäftigt stellt relativ schnell fest, dass die Konfiguration wenn man dann wirklich ein Cluster einsetzen möchte gar nicht so einfach ist.

Dieser Artikel soll in allen drei Fällen helfen. Man lernen den Hyper-V Server 2008 R2 kennen, ich zeige Ihnen wir man das System grafisch verwalten kann und wir konfigurieren einen kompletten Failover-Cluster. Dieser Cluster wird dabei nach unseren “Bestpractices” konfiguriert und steht damit in nichts der Vollinstallation nach. Im Gegenteil: die Core Edition hat noch den Vorteil, dass Sie wesentlich weniger Komponenten beinhaltet und damit viel weniger Patche benötigt. Das erhöht die Stabilität und verringert die Anzahl der Bootszenarien!

Deswegen zeige ich in diesem Blogartikel, wie man den Hyper-V Server 2008 R2 SP1 im Cluster installiert und zwar auf den Schulungssystemen aus unseren Hyper-V Powerkurs. Also los und bitte etwas Geduld mitbringen, der Blogartikel ist etwas “länglich”.

Netzwerk und Domäne

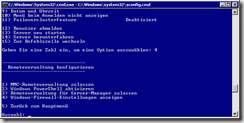

Nach der Basis Installation der beiden Hyper-V Server 2008 R2 SP1 stecken wir bei beiden Systemen die Management NIC ins Netzwerk. Wenn man einen DHCP Server im Netz hat bekommt das Interface damit eine DHCP Adresse. Diese ändern wir in dem wir im “sconfig” Tool (das Blaue Fenster) folgendes tun:

Punkt 8 “Netzwerkeinstellungen“ anwählen

Punkt 8 “Netzwerkeinstellungen“ anwählen- Zahl des Interface auswählen, welches wir ändern wollen

- Punk 1 “IP-Adresse des Adapters festlegen” auswählen

- “s” für statisch auswählen und IP-Adresse, Netzmaske und Gateway festlegen

- DNS über Punkt 2 “DNS-Server festlegen” konfigurieren

- über Punkt 4 “zurück zum Hauptmenü” wechseln

Da wir einige Aufgaben Remote ausführen wollen, sorgen wir dafür, dass die benötigten Remotemanagment Komponenten installiert und Remotedesktop aktiviert wird:

- Remotedesktop über Punkt 7 “Remotedesktop aktivieren“ aktivieren

“Remoteverwaltung” über Punkt 4 konfigurieren

“Remoteverwaltung” über Punkt 4 konfigurieren- “MMC-Remoteverwaltung” über Punkt 1 zulassen

- „Windows PowerShell” über Punkt 2 aktivieren und neustarten

- am System als lokaler Administrator anmelden

- über Punkt 4 wieder in die Remoteverwaltung wechseln

- “Remoteverwaltung für Windows ServerManager” über Punkt 3 zulassen

- über Punkt 5 wieder ins Hauptmenü wechseln

Als nächsten Schritt geben wir den Systemen einen Namen und nehmen sie in die Domäne auf:

- über Punkt 2 den “Computernamen” ändern

- über Punkt 1 der “Domäne” beitreten und rebooten

Jetzt können wir bereits die Systeme von einem anderen Server oder von einem Windows 7 Client, der die Microsoft RSAT Tools installiert hat, managen.

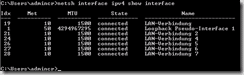

Mit Hilfe des Befehls “ipconfig” oder “netsh interface ipv4 show interfaces” prüfen wir als nächstes, ob alle unsere Netzwerkkarten vom System erkannt werden. Bei unseren Schulungssystemen fehlen die vier Port des Intel I340-T4 Karte. Damit das System diese erkennt, müssen jetzt die passenden Treiber nachinstalliert werden. Wir kopieren dazu das Intel Treiber Packet “PROWinx64.exe” nach “C:\System” und führen dann die Installation mittels des Befehls:

PROWinx64.exe

durch. Ein erneuter Aufruf von “ipconfig” zeigt uns nun, dass alle Netzwerkkarten erkannt wurden. Jetzt können wir die einzelnen Karten konfigurieren. Dazu benötigen wir ein weiteres Tool: NVSBIND. Auch dieses müssen wir an einem anderen System aus dem Internet downloaden und dann auf unsere Hyper-V Server in das Verzeichnis “C:\Tools” kopieren.

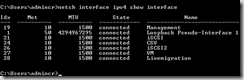

Namen der Netzwerk Ports

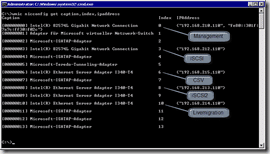

Wir haben uns wegen des besseren Verständnisses angewöhnt die Netzwerk Ports in unseren Hyper-V Installationen nach ihren Aufgaben zu benennen. In dem Screenshot rechts sieht man die Ausgabe des Befehls “netsh interface ipv4 show interfaces”. Er zeigt uns, unter anderem, die Netzwerkkartennamen. Jetzt gibt es aber ein Problem: wir haben festgestellt das es keine Zuordnung der Ports der Intel I340-T4 Karte zu den LAN-Verbindungen gibt. Deswegen hilft nur ausprobieren. Nachdem ich durch Stecken der einzelnen Ports und überprüfen mit dem “netsh” Befehl herausgefunden habe welcher Port welche Aufgabe bekommt, benennen wir diese mit dem Befehl

netsh interface set interface name=”Alter Name” newname=”Neuer Name”

um. Das heißt in unserem Beispiel:

um. Das heißt in unserem Beispiel:

netsh interface set interface name=”LAN-Verbindung” newname=”Management”

netsh interface set interface name=”LAN-Verbindung 2” newname=”iSCSI”

netsh interface set interface name=”LAN-Verbindung 4” newname=”CSV”

netsh interface set interface name=”LAN-Verbindung 5” newname=”iSCSI2”

netsh interface set interface name=”LAN-Verbindung 6”newname=”VM”

netsh interface set interface name=”LAN-Verbindung 7”newname=”Livemigration”

wird. Das Ergebnis sehen wir im Screenshot rechts.

Konfiguration des Management Ports

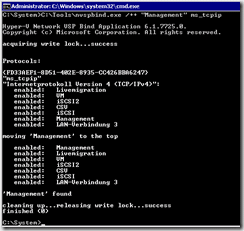

Bei unserem Management Interface ist schon fast alles wie es sein soll: es besitzt eine feste IP Adresse und alle benötigten Bindungen. Einzig die Netzwerkpriorität muss geändert werden, sie soll ganz nach oben. Dazu benutzen wir den “nvsbind” Befehl:

Bei unserem Management Interface ist schon fast alles wie es sein soll: es besitzt eine feste IP Adresse und alle benötigten Bindungen. Einzig die Netzwerkpriorität muss geändert werden, sie soll ganz nach oben. Dazu benutzen wir den “nvsbind” Befehl:

C:\Tools\nvspbind.exe /++ Management ms_tcpip

C:\Tools\nvspbind.exe /++ Management ms_tcpip6

Konfiguration der iSCSI und iSCSI2 Ports

Aus Redundanzgründen haben wir die beiden iSCSI NICs in unterschiedlichen Netzwerkkarten gesteckt. Einmal in die Onboard Dual Port Intel Karte und einmal in die Intel 340-T Karte. Im folgenden Schritt werden wir die überflüssigen Bindungen entfernen und die IP-Adressen der entsprechenden Netzwerke setzten.

Zuerst setzten wir die IPv4 Adresse der beiden Karten. In unserem Fall nutzen wir die Netzwerke “192.168.212” für iSCSI und “192.168.213” für iSCSI2 und hängen die IP des Hosts (hier die 110) in beiden Netzen an. Zur Konfiguration nehmen wir den “netsh”-Befehl:

netsh interface ipv4 set address ”iSCSI” static 192.168.212.110 255.255.255.0 none

netsh interface ipv4 set address ”iSCSI2” static 192.168.213.110 255.255.255.0 none

Als nächstes disablen wir alle Protokoll Bindungen, bis auf die des IPv4 Protokolls. Dazu benutzen wir “nvspbind” . Der erste Befehl schaltet dabei alle Protokoll Bindungen aus und der zweite Befehl schaltet nur “ms_tcp” (für IPv4) wieder ein:

C:\Tools\nvspbind.exe /d iSCSI *

C:\Tools\nvspbind.exe /e iSCSI ms_tcpipC:\Tools\nvspbind.exe /d iSCSI2 *

C:\Tools\nvspbind.exe /e iSCSI2 ms_tcpip

Konfiguration des Livemigration Ports

Als nächstes setzen wir die IPv4 Adresse des Livemigration Ports und schalten IPv6 ab. Der Livemigration Port benötigt alle Bindungen, da er auch als Backup für den CSV Port dient. Auch hier benutzen wir die schon bekannten Tools “nvspbind” und “netsh”:

netsh interface ipv4 set address ”Livemigration” static 192.168.214.110 255.255.255.0 none

C:\Tools\nvspbind.exe /d Livemigration ms_tcpip6

Konfiguration des CSV Ports

Der CSV Port wird für den “Cluster-Heartbeat”, aber auch für den “Redirected Access” des Clusters benutzt. Deshalb benötigen wir ein eigenes Netz, in unserem Beispiel das “192.168.215” Netz. Da der “Redirected Access” über SMB funktioniert, muss zusätzlich der Microsoft Netzwerkclient gebunden sein. Bestpractice ist allerdings die beiden Bindungen der “Topologieerkennung” auszuschalten. Hier sind die Befehle dazu:

netsh interface ipv4 set address ”CSV” static 192.168.215.110 255.255.255.0 none

C:\Tools\nvspbind.exe /d CSV ms_tcpip6

C:\Tools\nvspbind.exe /d CSV ms_rspndr

C:\Tools\nvspbind.exe /d CSV ms_lltdio

Konfiguration des VM Ports

Über den VM Port kommunizieren die Virtuellen Maschinen mit dem Netzwerk. Hier werden alle Protokolle entfernt und nur die virtuelle Switch aktiviert (siehe Screenshot rechts):

C:\Tools\nvspbind.exe /d VM *

C:\Tools\nvspbind.exe /e VM vms_pp

“NetBIOS über TCP/IP” und “DNS Registrierung” deaktivieren

Im nächsten Schritt möchten wir einerseits das Feature “NetBIOS über TCP/IP” deaktivieren und andererseits verhindern das die IP-Adressen unsere “Cluster-NICs” im DNS eingetragen werden. Zuerst müssen wir wissen, welchen Index unsere “Cluster-NICs” iSCSI, iSCSI2, CSV  und Livemigration haben. Dazu geben wir in der Kommandozeile folgenden Befehl ein:

und Livemigration haben. Dazu geben wir in der Kommandozeile folgenden Befehl ein:

wmic nicconfig get caption,index,ipaddress

Aus der Ausgabe dieses Befehls können wir anhand der angezeigten IP-Adressen die benötigten Indexe unserer Netzwerkkarten herauslesen (siehe Screenshot). Jetzt wenden wir folgende Befehle auf jeder der vier NICs an:

wmic nicconfig where index=<Index der NIC> call SetTcpipNetbios 2

wmic nicconfig where index=<Index der NIC> call SetDynamicDNSRegistration 0, 0

Hierbei ersetzen wir <Index der NIC> durch den Index aus dem Screenshot. Der erste Befehl deaktiviert das Feature “NetBIOS über TCP/IP” und der zweite schaltet “Adressen dieser Verbindung im DNS aktivieren” aus. Nachfolgend die Befehle für unser Netzwerke im Beispiel:

Für das iSCSI Interface:

wmic nicconfig where index=3 call SetTcpipNetbios 2

wmic nicconfig where index=3 call SetDynamicDNSRegistration 0, 0

Für das iSCSI2 Interface:

wmic nicconfig where index=8 call SetTcpipNetbios 2

wmic nicconfig where index=8 call SetDynamicDNSRegistration 0, 0

Für das CSV Interface:

wmic nicconfig where index=6 call SetTcpipNetbios 2

wmic nicconfig where index=6 call SetDynamicDNSRegistration 0, 0

Für das Livemigration Interface:

wmic nicconfig where index=10 call SetTcpipNetbios 2

wmic nicconfig where index=10 call SetDynamicDNSRegistration 0, 0

Bitte achten Sie unbedingt darauf das Ihnen jeder Befehl mit der Ausgabe:

Methode würde ausgeführt,

Ausgabeparamter:

instance of __PARAMETERS

{

ReturnValue = 0;

}

quitiert wird. Andernfalls muss man den Befehl und den Index der NIC prüfen.

Wir sind jetzt soweit, dass wir die Netzwerke benannt, ihnen feste IP-Adressen in den entsprechenden IP-Netzen gegeben und nur noch die nötigen Bindungen auf den Ports belassen haben. Jetzt gehen wir daran die iSCSI Anbindung an den benötigten Storage herzustellen.

iSCSI und MPIO

Da wir nach unserer Bestpractice zwei Verbindungen zum iSCSI Storage benötigen, müssen wir dafür sorgen, dass das Multipath-IO Feature des Betriebssystems installiert wird. Mit ihm ist es dann möglich, dass die redundanten Pfade zum Storage auch richtig benutzt werden. Unsere beiden Netzwerke haben wir schon als iSCSI und iSCSI2 im oberen Bereich des Beitrags konfiguriert, so dass wir nun das MPIO Feature nachinstallieren und den Microsoft DSM aktivieren müssen.

Hierzu rufen wir folgende beiden Befehle in einer Kommandozeile auf:

ocsetup MultipathIo /norestart

mpclaim -r -i -d „MSFT2005iSCSIBusType_0x9“

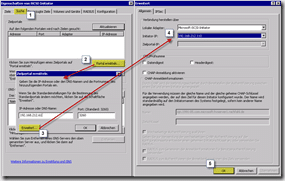

Das System rebootet und nach dem erneuten Einloggen starten wir in der Kommandozeile mit dem Befehl “iscsicpl” das iSCSI Control Panel.  Nach Bestätigung das der “Microsoft iSCSI-Initiator-Dienst” gestartet wird, konfigurieren wir nun die Anbindung unser Quorum und CSV Storage über zwei redundante Storage Pfade.

Nach Bestätigung das der “Microsoft iSCSI-Initiator-Dienst” gestartet wird, konfigurieren wir nun die Anbindung unser Quorum und CSV Storage über zwei redundante Storage Pfade.

Zur eigentlichen iSCSI und MPIO Konfiguration habe ich ein 11 Minütigen Videocast gedreht (Videocast: Wie man iSCSI und MPIO für Hyper-V konfiguriert). Deshalb erkläre ich die Konfiguration hier nur nochmal im Schnelldurchlauf.

Schritte nach Aufruf von “iscsicpl”:

- Auf Reiter “Suche” navigieren

- “Portal ermitteln…” anklicken

- erste IP-Adresse des iSCSI Storage (im Beispiel 192.168.212.61) eintragen und “Erweitert…” anklicken

- Microsoft iSCSI-Initiator auswählen und unter Initiator-IP die Adresse des Hosts aus dem gleichen Netz auswählen (im Beispiel 192.168.212.110)

- “OK” anklicken und im Dialog “Ziel verbinden…” auch “OK” anklicken

- Jetzt wechseln wir auf den Reiter “Ziele”

- Klicken erneut auf “Verbinden…”

- Wählen “Multipath aktivieren” aus

- und klicken auf “Erweitert…”

- im Dialog “Erweitert” konfigurieren wir unseren zweiten Pfad zum iSCSI Storage (im Beispiel 192.168.213.61)

- “OK” anklicken

- Im Dialog “mit Ziel verbinden…” auch “OK” anklicken

- Jetzt nochmal den Vorgang 7 bis 12 für die ursprüngliche IP-Adresse (192.168.212.61) wiederholen

Danach wechseln wir in den Reiter “Bevorzugte Ziele”

Danach wechseln wir in den Reiter “Bevorzugte Ziele”- hier prüfen wir ob wir zwei Einträge unter “Bevorzugte Ziele” finden

- dann wechseln wir auf den Reiter “Volumes und Geräte”

- Wenn die Volumeliste leer ist, klicken wir auf “Autom. konfigurieren” und es sollten unsere Ziele erscheinen

- “OK” anklicken

Wenn man diese Schritte auf allen zukünftigen Cluster Knoten durchgeführt hat, können wir unsere Volumes CSV1 und Quorum formatieren.

Vorbereitung und Anbindung des CSV1 und Quorum Volumes

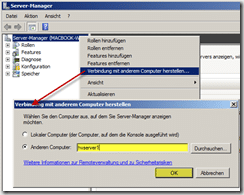

Dazu gibt es zwei Möglichkeiten: das Tool “Diskpart” und die “Speicherverwaltung” von “Windows Server 2008 R2” oder der “Windows 7 RSAT Tools”. Ich habe mir für die grafische Remote Variante entschieden. Deswegen öffne ich auf einem Windows 2008 R2 System den Servermanager (Achtung: man benötigt Domäne Administrator Rechte).

Dazu gibt es zwei Möglichkeiten: das Tool “Diskpart” und die “Speicherverwaltung” von “Windows Server 2008 R2” oder der “Windows 7 RSAT Tools”. Ich habe mir für die grafische Remote Variante entschieden. Deswegen öffne ich auf einem Windows 2008 R2 System den Servermanager (Achtung: man benötigt Domäne Administrator Rechte).

- Rechtsklick auf Servermanager und dann “Verbindung mit anderem Computer herstellen…” auswählen

- Im sich öffnen Dialog gibt man den Computernamen ein und klickt auf “OK”

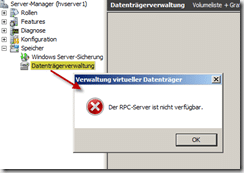

Jetzt öffnet sich der Servermanager mit der Verbindung zum Hyper-V Server (im Beispiel hvserver1). Im nächsten Schritt klicken wir auf “Speicher” und dort dann auf “Datenträgerverwaltung” und bekommen den Fehler “Der RPC-Server ist nicht verfügbar”. Zur Remote Datenträgerverwaltung gibt es einen Artikel von Jan Kappen: Grafische Datenträgerverwaltung eines Hyper-V Server R2 worin er diesen Fehler beschreibt. Es muss auf dem System auf dem der Servermanager läuft in der Firewall die

Jetzt öffnet sich der Servermanager mit der Verbindung zum Hyper-V Server (im Beispiel hvserver1). Im nächsten Schritt klicken wir auf “Speicher” und dort dann auf “Datenträgerverwaltung” und bekommen den Fehler “Der RPC-Server ist nicht verfügbar”. Zur Remote Datenträgerverwaltung gibt es einen Artikel von Jan Kappen: Grafische Datenträgerverwaltung eines Hyper-V Server R2 worin er diesen Fehler beschreibt. Es muss auf dem System auf dem der Servermanager läuft in der Firewall die  Remotevolumenverwaltung zugelassen werden. Diese Ausnahmen konfiguriert man wie folgt:

Remotevolumenverwaltung zugelassen werden. Diese Ausnahmen konfiguriert man wie folgt:

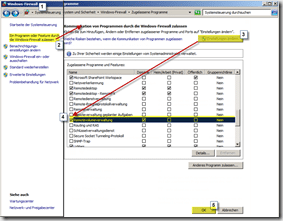

- Aufruf der “Windows FireWall” über die Systemsteuerung

- Klick auf “ein Programm oder Feature durch Windows FireWall zulassen”

- Modifikation der Einstellungen durch klicken auf “Einstellungen ändern” einschalten

- Bis zu “Remotevolumenverwaltung” scrollen und durch klick auf die Checkbox für das “Domainenprofil” aktivieren

- Mit “OK” bestätigen

Jetzt können wir uns erneut im Servermanager mit dem Hyper-V Server 2008 R2 verbinden und nachdem wir auf “Datenträgerverwaltung” geklickt haben, sind wir mit dem Hyper-V Server verbunden.

Jetzt können wir uns erneut im Servermanager mit dem Hyper-V Server 2008 R2 verbinden und nachdem wir auf “Datenträgerverwaltung” geklickt haben, sind wir mit dem Hyper-V Server verbunden.

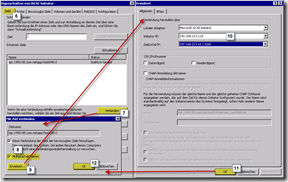

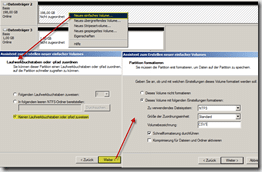

Der “Datenträgerinitialisierung” Dialog erscheint (1) und wir müssen unsere beiden Volumes (2) initialisieren. Hier belassen es beim Default “MBR” und klicken auf “OK”.

Im nächsten Schritt formatieren wir auf dem ersten Clusterknoten die beiden Partitionen.  Dazu rechtsklicken wir in das größere der beiden Volumes (im Beispiel neben Datenträger 2 in den schraffiert Bereich) und erzeugen ein “Neues einfaches Volume”:

Dazu rechtsklicken wir in das größere der beiden Volumes (im Beispiel neben Datenträger 2 in den schraffiert Bereich) und erzeugen ein “Neues einfaches Volume”:

- den ersten Dialog überspringen wir mit klick auf “Weiter”

- Im folgenden Dialog klicken wir “Keinen Laufwerksbuchstaben oder –pfad zuweisen” an und dann auf “Weiter”

- Dann wählen wir “Dieses Volume mit folgenden Einstellungen formatieren:” an und belassen Werte (NTFS, Standard, “Schnellformatierung durchführen”) auf ihren Standardwerten. Nur bei dem Namen vergeben wir für das große Volume “CSV1”.

- Danach klicken wir auf “Weiter” und auf der im folgenden Dialog auf “Fertig stellen”

Die obigen Schritte führen wir auch für das zweite, kleinere Volume aus (im Beispiel Datenträger 3 mit 1 GB) nur das wir das Volume dabei “Quorum” nennen.

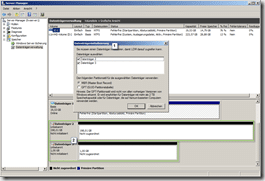

Nun schalten wir beide Datenträger Offline indem wir auf Datenträger rechtsklicken und dann Offline anwählen. Im Screenshot rechts sieht man wie Datenträger 2 bereits Offline ist und wir den Vorgang bei Datenträger 3 gerade ausführen.

Nun schalten wir beide Datenträger Offline indem wir auf Datenträger rechtsklicken und dann Offline anwählen. Im Screenshot rechts sieht man wie Datenträger 2 bereits Offline ist und wir den Vorgang bei Datenträger 3 gerade ausführen.

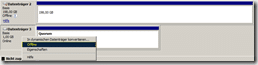

Nun führen wir die Datenträgerverwaltung für die weiteren Hyper-V Server 2008 R2 durch. Dazu verbinden wir den Servermanager mit dem nächsten System (im Beispiel hvserver5) und klicken auf die “Datenträgerverwaltung”. Hier müssen wir dann ebenfalls die Datenträgerinitialisierung der beiden Volumes durchführen.

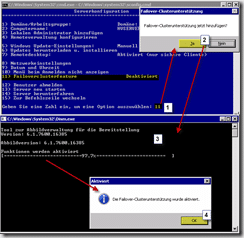

Installation Failover-Clusterunterstützung

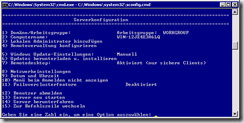

Das Failovercluster Feature wird über die Hyper-V Server Konsole installiert. Man geht dazu wie folgt vor:

- Im “sconfig” Punkt 11 “Failoverclusterfeature” eingeben

- Dim Dialog “Failover-Clusterünterstützung jetzt hinzufügen?” auf “Ja” klicken

- Danach läuft die Installation durch, deren Fertigstellung mit Klick auf “OK” bestätigt

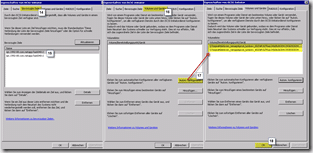

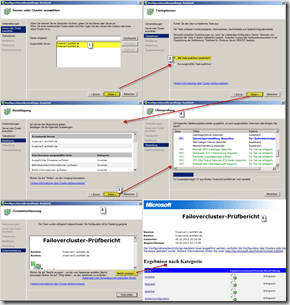

Als nächstes richten wir den Failover-Cluster ein. Hierzu benötigen wir wieder entweder die “Windows 7 RSAT Tools” oder einen “Windows 2008 R2 Server” mit mindestens der Enterprise Edition. Mein Notebook hat Windows Server 2008 R2 SP1 Enterprise installiert, weswegen ich über “Start –> Verwaltung” den Failovercluster-Manager aufrufe. Bevor wir den Cluster erstellen lassen wir die Clustervalidierung laufen. Diese rufen wir auf, indem wir im mittleren Bereich auf “Konfiguration prüfen…” klicken.

- Jetzt geben wir die an dem Failover-Cluster beteiligten Systeme ein und klicken auf “Weiter”

- “Alle Tests ausführen (empfohlen)” anwählen und auf “Weiter” klicken

- “Weiter” anklicken um die Validierung zu starten

- Die Validierung läuft

- Nach der Validierung wir der Failovercluster-Prüfbericht angezeigt. Hier klicken wir auf “Bericht anzeigen…”

- Failovercluster-Prüfbericht prüfen

Nachdem die Validierung durchgelaufen ist, prüfen wir den Bericht auf Fehler. Falls Fehler angezeigt werden sind diese zu beseitigen und danach eine erneute Validierung durchzuführen.

In unserem Fall gab es keine Fehler, sodass wir mit der eigentlichen Cluster Einrichtung starten können. Um dies zu tun klicken wir im mittleren Bereich des Failovercluster-Managers auf den Link “Cluster erstellen…” und es öffnet sich der “Clustererstellungs-Assistent”.

In unserem Fall gab es keine Fehler, sodass wir mit der eigentlichen Cluster Einrichtung starten können. Um dies zu tun klicken wir im mittleren Bereich des Failovercluster-Managers auf den Link “Cluster erstellen…” und es öffnet sich der “Clustererstellungs-Assistent”.

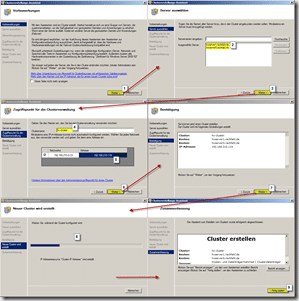

- Durchlesen der Einführung und dann auf “Weiter” klicken

- Servernamen der an dem Failover-Cluster beteiligten Systeme eingeben

- “Weiter” klicken

- Cluster Name und Cluster IP-Adresse eingeben

- “Weiter” klicken

- Bestätigung prüfen und dann “Weiter” anklicken

- Clusterinstallation abwarten

- Zusammenfassung anschauen und mit “Fertig stellen” Installation beenden

Falls die Zusammenfassung keine Fehler enthält haben wir nun die Grundinstallation des Failover-Clusters durchgeführt.

Konfiguration des Failover-Clusters

Um das eigentliche “Feintuning” des Failover-Clusters durchzuführen, starten wir wieder den Failovercluster-Manager. Wir wählen im mittleren Fenster den Link “Cluster verwalten…” und verbinden uns mit dem Cluster. Als nächstes werden wir folgende Themen bearbeiten:

- Einrichtung des Netzwerkkonfiguration (welches Netz übernimmt welche Aufgabe)

- Wir werden das “Freigegebenen Clustervolume” aktivieren (Cluster Shared Volume)

Netzwerkkonfiguration

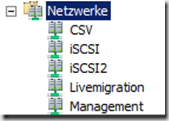

Wenn wir im linken Fenster “Netzwerke” öffnen, dann sehen wir die Netze “Clusternetzwerk 1” bis “Clusternetzwerk 5”. Das sind nicht wirklich sprechende Namen, mit denen man im Problemfall nicht wirklich etwas anfangen kann. Um das zu ändern müssen wir wissen wie die Netze heißen. Wenn wir ein Netzwerk anklicken, dann sehen wir im Mittelbereich welche Netzwerkkarten daran beteiligt sind. Mit diesem Wissen können wir das Netzwerk jetzt über drücken der “F2” Taste umbenennen. Wenn wir das mit allen Netzwerken getan haben, heißen diese nun “Management”, “Livemigration”, “CSV”, “iSCSI” und “iSCSI2”.

Wenn wir im linken Fenster “Netzwerke” öffnen, dann sehen wir die Netze “Clusternetzwerk 1” bis “Clusternetzwerk 5”. Das sind nicht wirklich sprechende Namen, mit denen man im Problemfall nicht wirklich etwas anfangen kann. Um das zu ändern müssen wir wissen wie die Netze heißen. Wenn wir ein Netzwerk anklicken, dann sehen wir im Mittelbereich welche Netzwerkkarten daran beteiligt sind. Mit diesem Wissen können wir das Netzwerk jetzt über drücken der “F2” Taste umbenennen. Wenn wir das mit allen Netzwerken getan haben, heißen diese nun “Management”, “Livemigration”, “CSV”, “iSCSI” und “iSCSI2”.

Jetzt konfigurieren wir, welches Netz für die Clusterkommunikation(Cluster Heartbeat) benutzt wird.

Jetzt konfigurieren wir, welches Netz für die Clusterkommunikation(Cluster Heartbeat) benutzt wird.

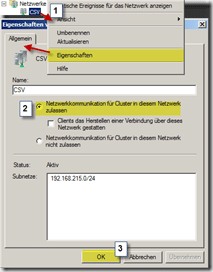

- Dazu rechtsklicken wir auf das Netz “CSV” und wählen “Eigenschaften” aus

- den Punkt “Netzwerkkomunikation für Cluster in diesem Netzwerk zulassen” anklicken und mit

- “OK” bestätigen

Die gleichen Einstellungen wiederholen wir beim Netzwerk “Livemigration” und “Management”. Allerdings aktivieren wir im “Management” Netz zusätzlich die Checkbox “Client das Herstellen einer Verbindung über dieses Netzwerk gestatten”. Bei den beiden “iSCSI” und “iSCSI2” Netzwerken stellen wir den Punkt “Netzwerkkommunikation für Cluster in diesem Netzwerk nicht zulassen” ein, da diese nicht für den Cluster Heartbeat benutzt werden sollen.

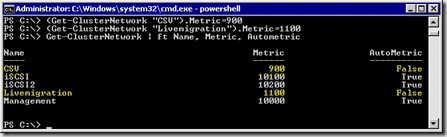

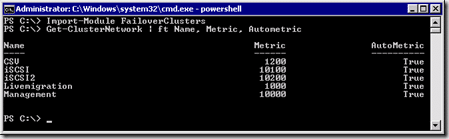

Als nächstes konfigurieren wir das Netz, über den der Cluster den “Redirected Access” abwickelt soll. Hierzu müssen wir auf einen der Hyper-V Server 2008 R2 wechseln. Dort öffnen wir die PowerShell, indem wir in einer Kommandozeile “powershell” eingeben. Danach laden wir das Powershell FailoverCluster Module und lassen uns die Metriken der Netzwerkschnittstellen anzeigen:

Import-Module FailoverClusters

Get-ClusterNetwork | ft Name, Metric, Autometric

Das Netzwerk mit der niedrigsten Metrik wird vom Cluster automatisch für den “Redirected Access” genutzt. In unserem Fall ist das, das “Livemigration” Netz. Deshalb setzen wir die Metrik des “CSV” Netzes und des “Livemigration” Netzes per Hand neu. Hierzu nutzen wir in der PowerShell folgende Befehle:

Das Netzwerk mit der niedrigsten Metrik wird vom Cluster automatisch für den “Redirected Access” genutzt. In unserem Fall ist das, das “Livemigration” Netz. Deshalb setzen wir die Metrik des “CSV” Netzes und des “Livemigration” Netzes per Hand neu. Hierzu nutzen wir in der PowerShell folgende Befehle:

(Get-ClusterNetwork “CSV”).Metric=900

(Get-ClusterNetwork “Livemigration”).Metric=1100

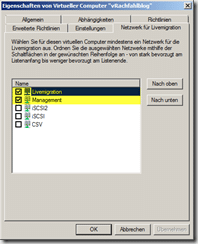

Im Screenshot sehen wir dass nun das “CSV” Netzwerk die niedrigste Metrik besitzt und damit für den “Redirected Access” benutzt wird. Ebenso haben wir damit das Netz für die “Livemigration” bestimmt. Es wird das Netz mit der zweitniedrigsten Metrik benutzt. Wirklich festlegen sollte man dies aber im Failovercluster-Manager. Hierzu müssen wir die Eigenschaften einer hochverfügbaren Virtual Maschine aufrufen. Dann wechseln wir über den Reiter “Netzwerk für Livemigration” in die Liste der Netzwerke. Hier sehen wir, dass das “Livemigration” Netzwerk ganz oben steht. Wenn das nicht der Fall ist wählt man das entsprechende Netz an und klickt solange auf “Nach oben” bis es an erster Stelle steht. Im Screenshot sehen wir, dass das “Management” Netzwerk ebenfalls mit einem Hacken versehen ist und an zweiter Stelle steht. Mit dieser Einstellung legen wir fest, über welches Ausfallnetz der Cluster im Falle eines Problems mit dem “Livemigration” Netzwerk den Speicher der VMs verschieben soll.

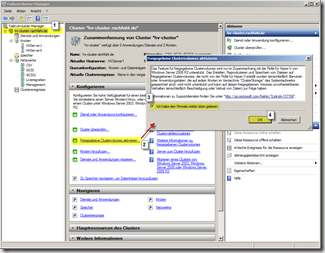

Freigegebene Clustervolume aktivieren

Im letzten Schritt aktivieren wir die Clustervolumes. Wir tuen dies, indem wir:

Im letzten Schritt aktivieren wir die Clustervolumes. Wir tuen dies, indem wir:

- im linken Bereich den Cluster anwählen

- dann im mittleren Fenster auf den Link “freigegeben Clustervolume aktivieren…” klicken

- Im Dialog müssen wir das Lesen des Hinweis mit anklicken der Checkbox “Ich habe den Hinweis gelesen” bestätigen

- Danach kann man die Aktivierung mit klicken auf “OK” aktivieren

Nachdem wir den Vorgang ausgeführt haben erscheint im linken Navigationsbereich der Punkt “Freigegebene Clustervolumes“. Um ein CSV-Volumen bereitzustellen müsssen wir folgendes tun:

Nachdem wir den Vorgang ausgeführt haben erscheint im linken Navigationsbereich der Punkt “Freigegebene Clustervolumes“. Um ein CSV-Volumen bereitzustellen müsssen wir folgendes tun:

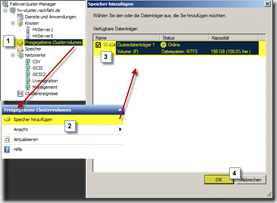

- Wir klicken den Punkt “Freigegebene Clustervolumes“ an

- Im rechten Bereich klicken wir dann auf “Speicher hinzufügen”

- Im Dialog bekommen wir das “CSV1” Volume angeboten welches wir durch klicken der Checkbox auswählen

- Um die die Einrichtung abzuschließen klicken wir “OK”

Nun haben wir das erste Cluster Shared Volume aktiviert. Zur Prüfung schauen wir auf einem der Hyper-V Server 2008 R2, ob wir unter C:\ClusterStorage” ein Verzeichnis “Volume1” finden.

Was kommt als nächstes

Wir haben nun einen robusten, hochverfügbaren Hyper-V Cluster der nun mit VMs bespielt werden kann. Diese kann man entweder im Failovercluster-Manager anlegen oder exportierte VMs nach “C:\ClusterStorage\Volume1” kopieren und dann in den Cluster importierten.

Ich hoffe ich habe sie mit den vielen Schritten nicht abgeschreckt und wünsche viel Spaß beim Virtualisieren.