In diesem Blogbeitrag möchte ich aufzeigen wie mit dem System Center Virtual Machine Manager ein Storage Spaces Direct Cluster erzeugt werden kann und welche Voraussetzungen notwendig sind; was die Installation des System Center Virtual Machine Manager 2016 erfordert, habe ich bereits  in einem früheren Blogbeitrag beschrieben; den gibt es hier, daher gehe ich heute nicht näher darauf ein.

in einem früheren Blogbeitrag beschrieben; den gibt es hier, daher gehe ich heute nicht näher darauf ein.

Bei unserer Testumgebung sind alle S2D Knoten mit Windows 2016 Datacenter Edition installiert und auch alle notwendigen Dell-Treiber für eine Storage Spaces Direct Umgebung bereits eingespielt. Bei einer Storage Spaces Direct Umgebung ist es wichtig, dass nur die Treiber verwendet werden, die von den verschiedenen Herstellern für solche Umgebungen freigegeben worden sind.

Der System Center Virtual Machine Management Server wurde als VM auf Basis Windows Server 2016 mit dem Virtual Machine Manager 2016 installiert. Der Virtual Machine Management Server wurde mit dem aktuellen Update Rollup 1 für VMM 2016 gepatcht.

Unsere Hardware:

- 4x Dell Server

- PowerEdge R730xd

- 128 GB RAM

- 2x E5-2640v3 2,6 GHz 8 Core CPUs

Festplatten pro Server:

- 1x NVMe Dell Express Flash 1,5 TB

- 4x SSDs Intel SSDSC2BX80 750 GB

- 8x HDDs Thoshiba MG04ACA4 3,7 TB

Netzwerkkarten:

- 1x Intel 4p i350-t

- 4x Mellanox ConnectX-3 Pro Ethernadapter

An den Servern wurden folgende Netzwerke konfiguriert:

- Mgmt-Team über 2 1GB Nics für das Server Lan

- VM-Switch Team über 2 Mellanox Karten für den VM-Switch

- SMB1 und SMB2 jeweils auf einer Mellanox Karte

VMM Konfiguration:

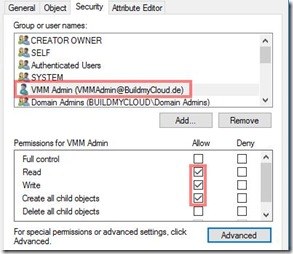

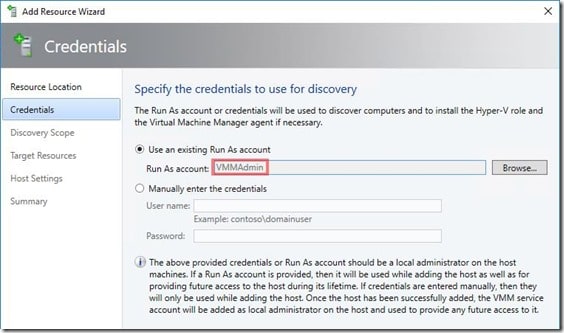

RunAsAccount:

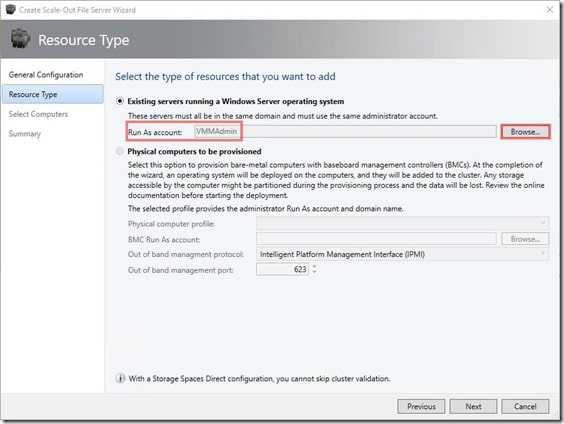

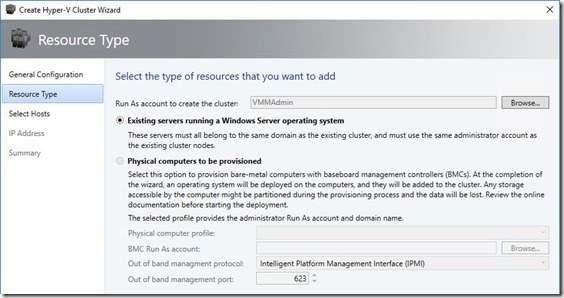

Der Domain Account “VMMAdmin” wurde als RunAsAccount im VMM angelegt. Der “VMMAdmin” ist auf allen S2D Knoten Mitglied der lokalen Administrator-Gruppe. Außerdem benötigt er in der AD auf die OU in der die S2D Computerkonten liegen “Read, Write, Create all child objects” auf diese OU und alle untergeordneten Objekte.

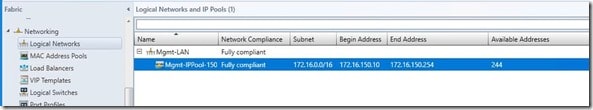

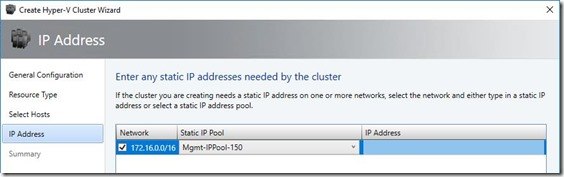

Logical Networks:

als logisches Netzwerk haben wir das Mgmt-Lan im VMM mit einem IP Pool angelegt. Das ist notwendig, da die gewünschte Cluster IP Adresse aus diesem Pool zur Verfügung gestellt wird.

Nun kann das Storage Spaces Direct Cluster über den SCVMM 2016 erstellt werden:

Hierbei haben wir zwei Möglichkeiten; entweder Storage Spaces Direct mit der SOFS-Rolle oder den Storage Spaces Direct Hyper Convered Ansatz.

Wo liegt der Unterschied?

Beim Storage Spaces Direct mit der SOFS-Rolle stelle ich eine Storage Spaces Direct Umgebung mit SMB-Freigaben zur Verfügung. In dieser Freigabe können entweder VMs oder SQL Datenbanken abgelegt werden, auf die über das SMB Netzwerk vom Hyper-V oder SQL Servern zugegriffen wird. Beim Storage Spaces Direct Hyper Convered Ansatz ist die Hyper-V Rolle direkt mit auf den Storage Spaces Direct Servern installiert und die VMs werden lokal unter “C:\ClusterStorage\……” in die einzelnen CSVs abgelegt. Bei der Hyper Convered Variante werden keine SMB-Freigaben erstellt.

Ich zeige beide Wege auf.

Der SCVMM installiert alle notwendigen Rollen auf den Servern, dazu allerdings keine Verwaltungstools.

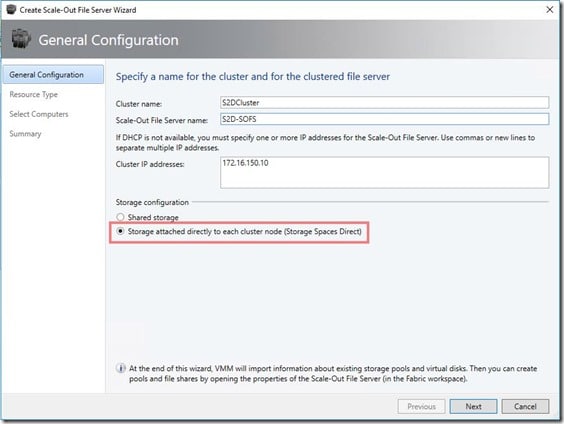

Zunächst den Weg für die Storage Spaces Direct Option mit der Scale Out File Server -Rolle:

Wir wählen im SCVMM den Bereich “Fabric\Server” und können dann auf Create\File Server Cluster gehen.

Wir wählen im SCVMM den Bereich “Fabric\Server” und können dann auf Create\File Server Cluster gehen.

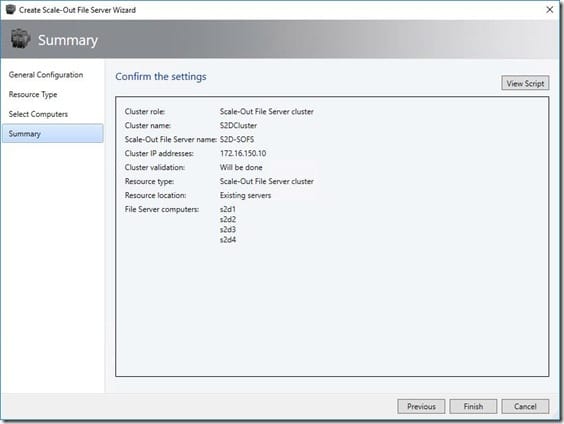

In diesem Fenster geben wir den Clusternamen, den Namen der SOFS-Rolle, sowie die Cluster IP-Adresse an und ganz wichtig; wir wählen aus, dass es sich um ein Storage Spaces Direct Cluster handeln soll.

Mit “Finish” starten wir die Installation des Storage Spaces Direct Cluster mit der SOFS- Rolle

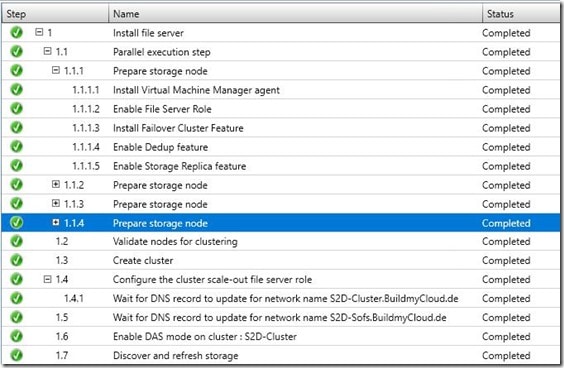

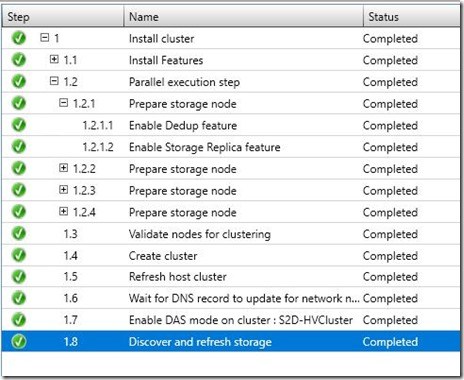

Folgende Punkte werden während der Installation abgearbeitet:

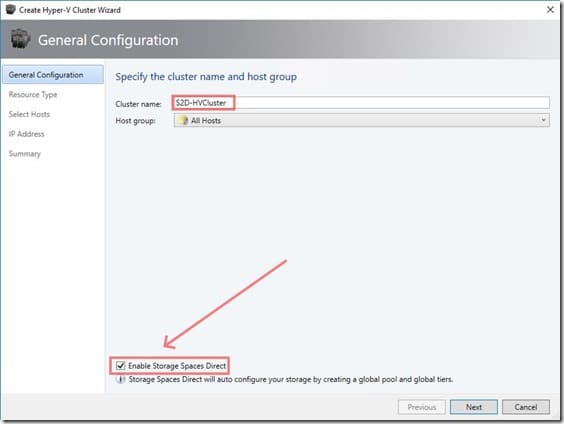

Welche Schritte sind zu tun, um die Storage Spaces Direct in der Hyper Converged Variante zu installieren?

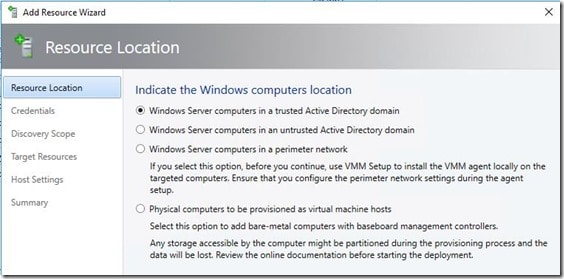

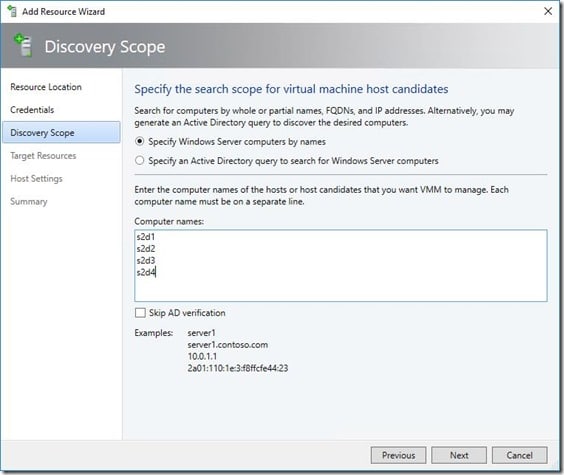

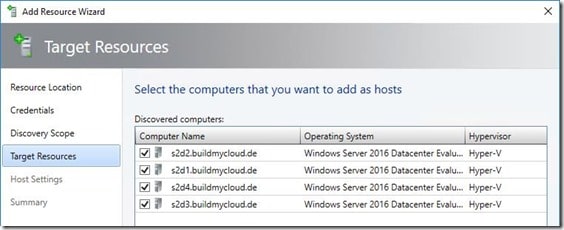

Zunächst müssen die Server zum SCVMM hinzugefügt werden, das erfolgt über “Fabric\Server\Add Resources\….

bei diesem Schritt wird der VMM Agent und die Hyper-V Rolle auf dem Server installiert.

Der Hyper-V Host und auch die Scale Out File Server müssen mit demselben RunAsAccount zum SCVMM hinzugefügt werden.

Bei mir in der Testumgebung ist dies “VMMAdmin”.

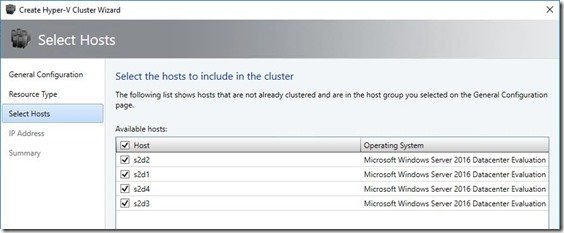

Dort wähle ich die vier S2D-Nodes aus — die Hyper-V Rolle ist bei uns bereits installiert.

Wir gehen weiter mit “next” und fügen die Server zum SCVMM hinzu. Nachdem die vier Nodes erfolgreich hinzugefügt wurden, kann das Hyper-V Cluster angelegt werden.

Wir können für die Cluster IPAdresse eine IP aus dem IP Pool zuweisen lassen oder eine eigene IP Adresse eingeben, diese muss dann auch nicht aus dem Bereich des IP Pools sein.

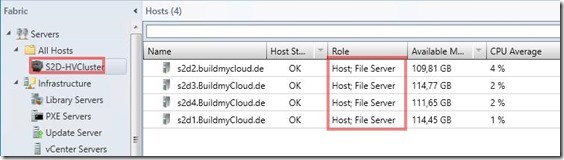

Nach Abschluss der Installation sehen wir das Cluster im SCVMM.

Bei der Installation des Storage Spaces Direct Hyper-V Clusters wurden vom SCVMM folgende Schritte ausgeführt.

Was wurde nun im SCVMM alles angelegt?

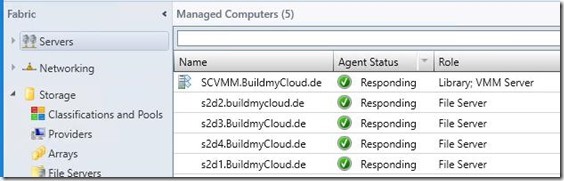

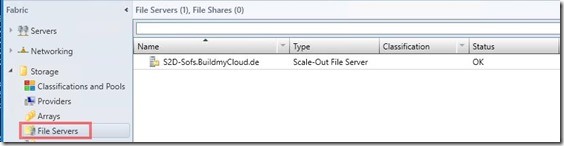

Im Bereich “Servers” sehen wir die vier File Server Nodes, im Unterschied dazu wird bei der Hyper Converged Variante hier das Hyper-V Failover Cluster angezeigt.

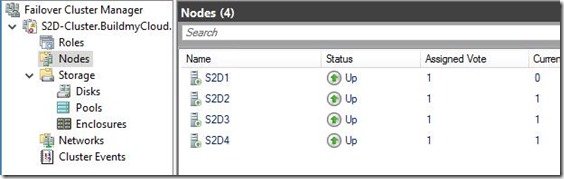

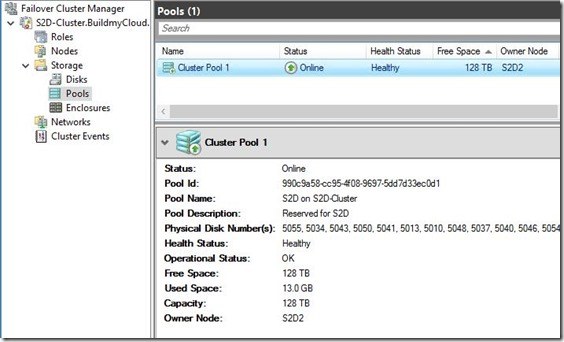

Im Failover Cluster Manager sieht es wie folgt aus:

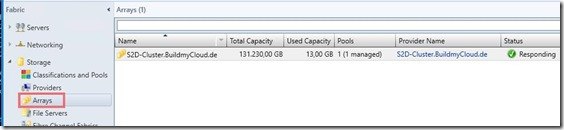

Die nächsten zwei Punkte sind bei beiden Varianten gleich. Im Bereich “Fabric\Storage” finden wir unter “Providers” unser S2D-Cluster Objekt.

Unter “Array” sehen wir die Kapazität des Pools und dass dieser vom SCVMM verwaltet wird.

im Failover Cluster Manager sehen wir Folgendes.

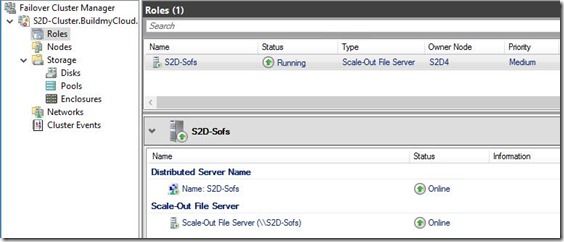

Unter “File Servers” sehen wir die SOFS-Rolle — “S2D-SOFS”

bei der Hyper Converged Variante gibt es die FileServer Rolle nicht.

im Failover Cluster Manager sieht es wie folgt aus.

Hyper Converged Variante:

Alles Weitere ist in beiden Varianten gleich.

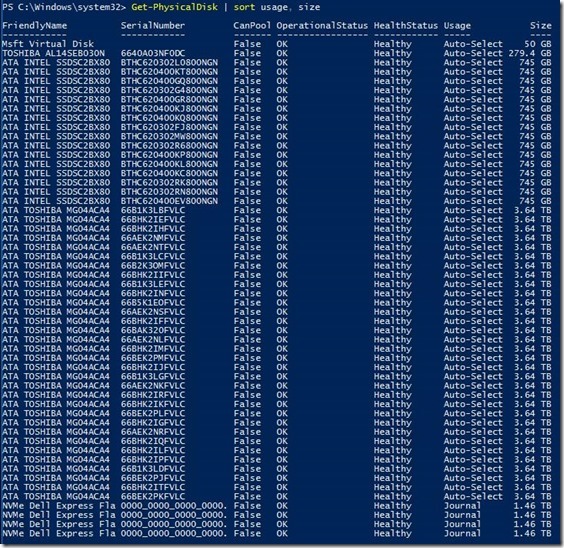

Über den PowerShell Befehl “Get-PhysicalDisk” ist zu sehen, dass die NVMe Disks als schnellstes Medium automatisch für den Cache (Journal) verwendet werden, während die SSDs und HDDs zum Pool hinzugefügt werden.

werfen wir noch einen Blick auf das Storagetiering:

- HDDs werden einem Capacity Tier mit Parity als Sicherheit zugewiesen

- SSDs einem Performance Tier mit Spiegelung

Wer nähere Infos zu “Volume resiliency and efficiency” haben möchte, sollte sich folgenden Technet Artikel von Claus Joergensen (Principal Program Manager for Storage Spaces Direct at Microsoft) anschauen.

In einem weiteren Blogpost zeige ich Euch, wie über den SCVMM die CSV-Disks angelegt werden. Viel Spaß und Erfolg beim testen und ausprobieren.