Überblick

Mit der HP LeftHand P4000 Virtual SAN Appliance Software hat man die Möglichkeit, sich ohne den Kauf einer speziellen SAN-Hardware ein Cluster-fähiges SAN aufzubauen und z.B. für ein Hyper-V-Cluster zu nutzen. Das Prinzip ist recht simpel: Man installiert auf mindestens einem Hyper-V oder ESX-zertifiziertem HP-Server (ProLiant oder c-Class-Blade) die SAN-Software. Die Software richtet eine virtuelle Maschine ein, in der die Software läuft. Dieser virtuellen Maschine wird Festplatten-Speicher zugeordnet, entweder über mehrere VHD-Dateien oder mit einer Pass-Through-Disk. Dieser Festplattenplatz kann dann im Netzwerk freigegeben werden und andere Server können auf den Speicherplatz per iSCSI zugreifen. Um eine zusätzliche Redundanz zu schaffen, kann man mehrere VSA-Server auf verschiedenen Hosts installieren und diese in einer Management-Gruppe zusammenfassen. Je nach Konfiguration kann man den Speicher im Netzwerk als Netzwerk-RAID10 definieren, d.h. bei einem Ausfall oder bei einem Neustart eines Hosts sind die Daten trotzdem erreichbar. Zusätzlich zu dem Ausfall-Schutz kommt noch ein Geschwindigkeitsvorteil hinzu, wenn beide (bzw. alle Server) im Netz erreichbar sind, ähnlich dem Verhalten eines Festplatten-RAID1/RAID10.

Mit der HP LeftHand P4000 Virtual SAN Appliance Software hat man die Möglichkeit, sich ohne den Kauf einer speziellen SAN-Hardware ein Cluster-fähiges SAN aufzubauen und z.B. für ein Hyper-V-Cluster zu nutzen. Das Prinzip ist recht simpel: Man installiert auf mindestens einem Hyper-V oder ESX-zertifiziertem HP-Server (ProLiant oder c-Class-Blade) die SAN-Software. Die Software richtet eine virtuelle Maschine ein, in der die Software läuft. Dieser virtuellen Maschine wird Festplatten-Speicher zugeordnet, entweder über mehrere VHD-Dateien oder mit einer Pass-Through-Disk. Dieser Festplattenplatz kann dann im Netzwerk freigegeben werden und andere Server können auf den Speicherplatz per iSCSI zugreifen. Um eine zusätzliche Redundanz zu schaffen, kann man mehrere VSA-Server auf verschiedenen Hosts installieren und diese in einer Management-Gruppe zusammenfassen. Je nach Konfiguration kann man den Speicher im Netzwerk als Netzwerk-RAID10 definieren, d.h. bei einem Ausfall oder bei einem Neustart eines Hosts sind die Daten trotzdem erreichbar. Zusätzlich zu dem Ausfall-Schutz kommt noch ein Geschwindigkeitsvorteil hinzu, wenn beide (bzw. alle Server) im Netz erreichbar sind, ähnlich dem Verhalten eines Festplatten-RAID1/RAID10.

Die Installation

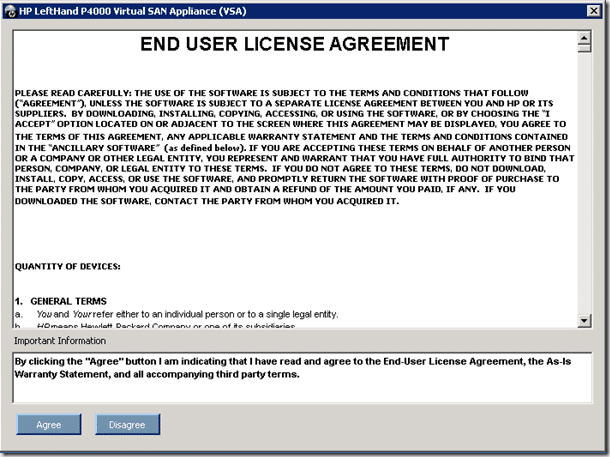

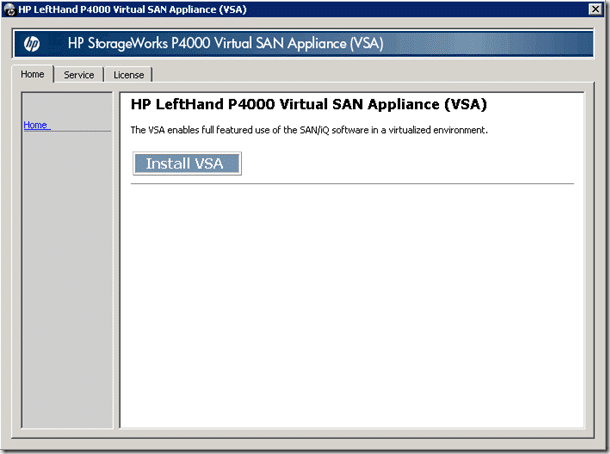

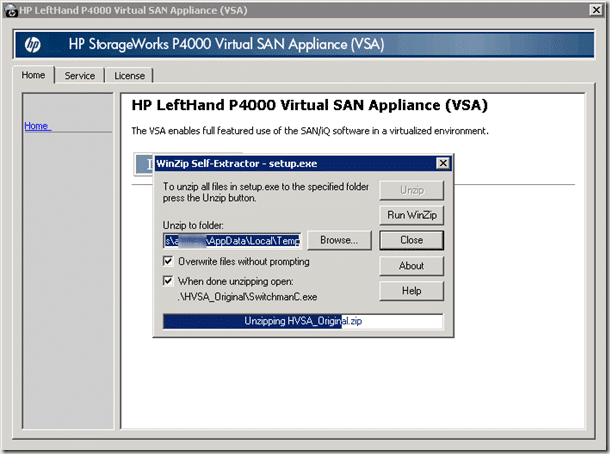

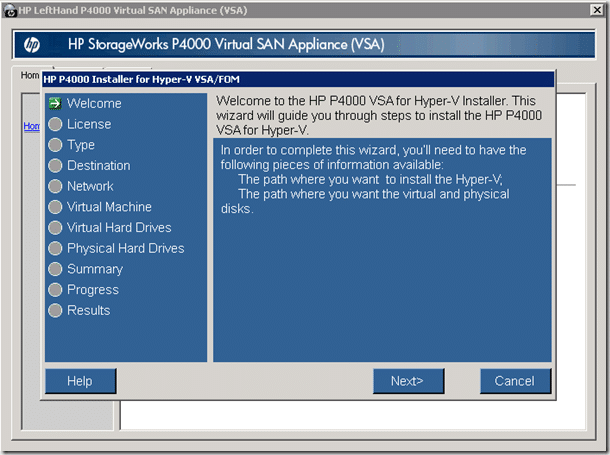

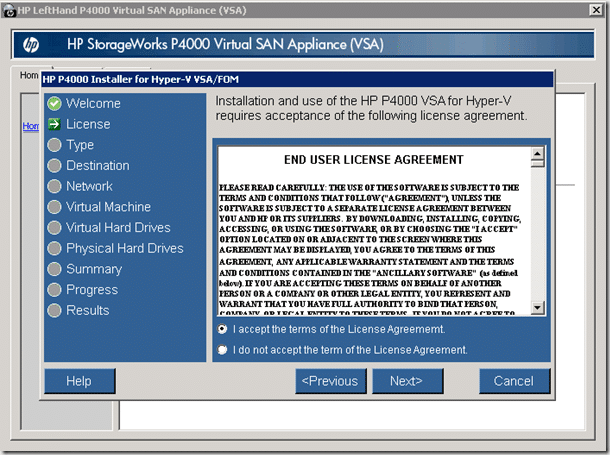

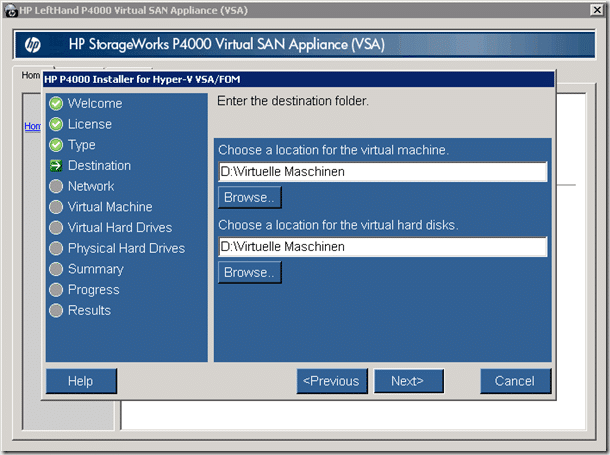

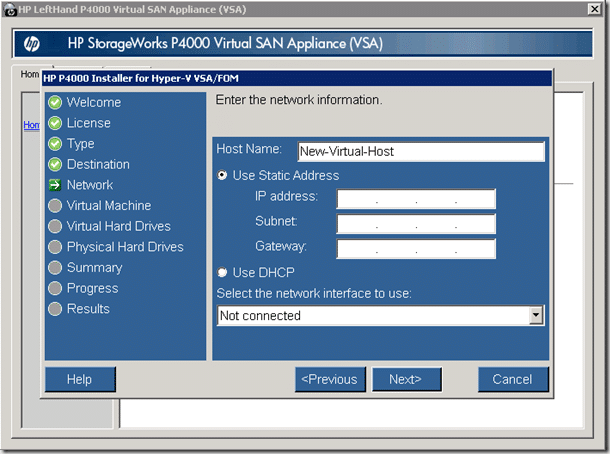

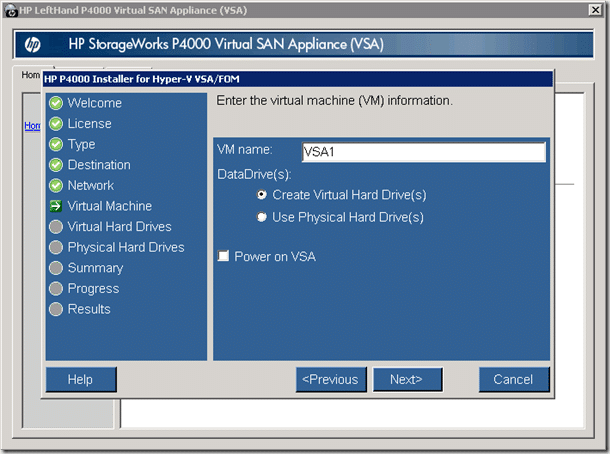

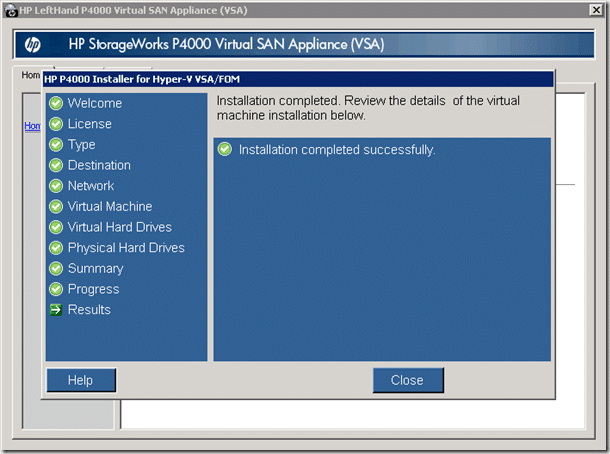

Die Installation der Software gestaltet sich als recht einfach. Auf dem Hyper-V Host wird das Setup aufgerufen, welches mit einem Wizard durch die Installation führt. Hier eine Reihe von Screenshots, die die Installation der einer VSA-Maschine zeigen:

Nach den Lizenzbedingungen und dem Entpacken der Setup-Dateien startet die eigentliche Installation

An der folgenden Stelle sollte man darauf achten, dass für die Maschine kein zusätzlicher Ordner angelegt wird

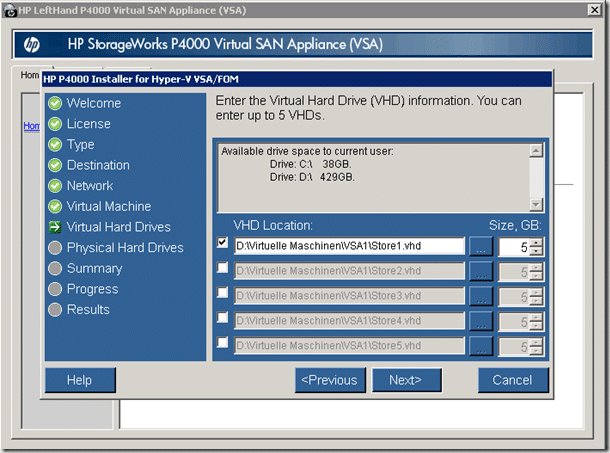

Man kann nun wählen, ob man VHD-Dateien als Speicherplatz nimmt oder Pass-Through-Disks. Letztere bieten eine höhere Performance. Zu Testzwecken nehme ich eine VHD-Datei mit 5 GB Größe.

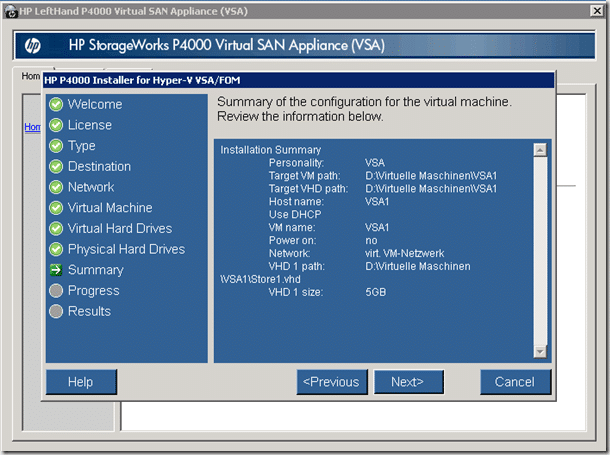

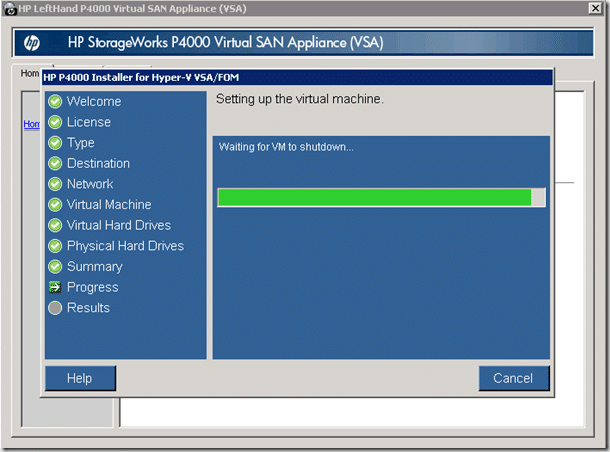

Nach dem Bestätigen von Next wird die Maschine angelegt

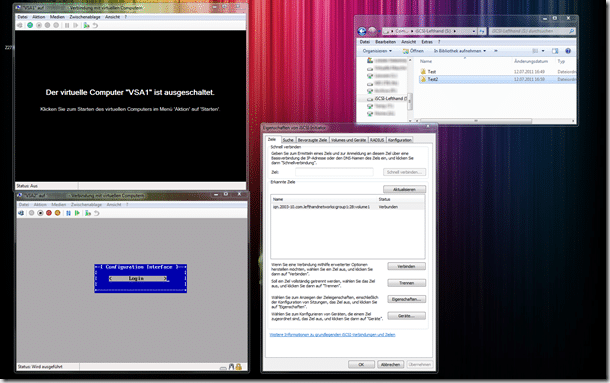

Man kann sich den Erstellungs-Prozess auch im Hyper-V-Manager anschauen

Nach wenigen Minuten ist die Installation beendet

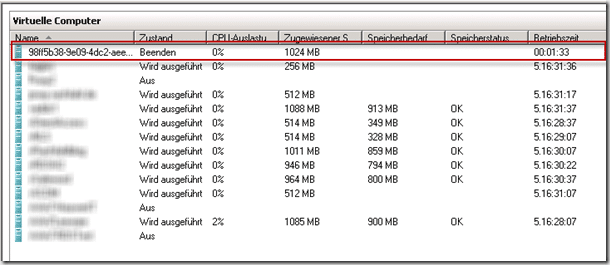

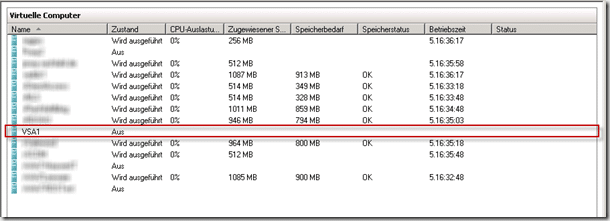

Im Hyper-V-Manager erkannt man nun, dass die virtuelle Maschine korrekt benannt wurde und wie gewünscht nicht eingeschaltet wurde

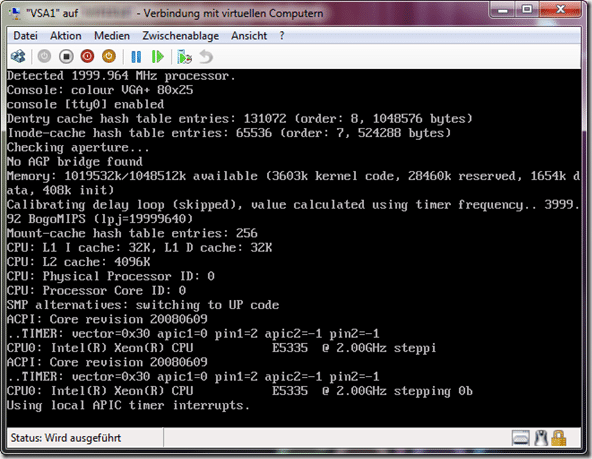

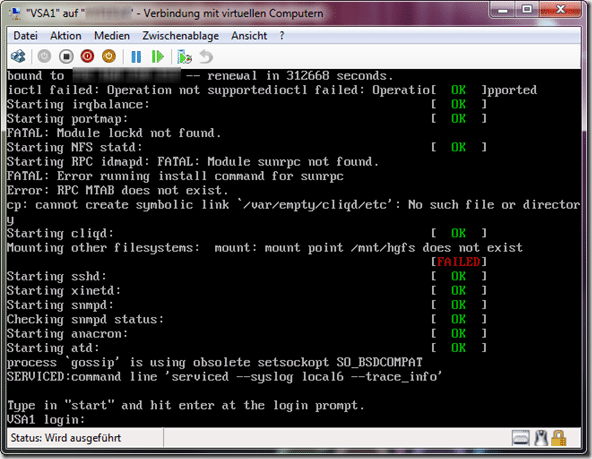

Der Start der Maschine sieht wie folgt aus

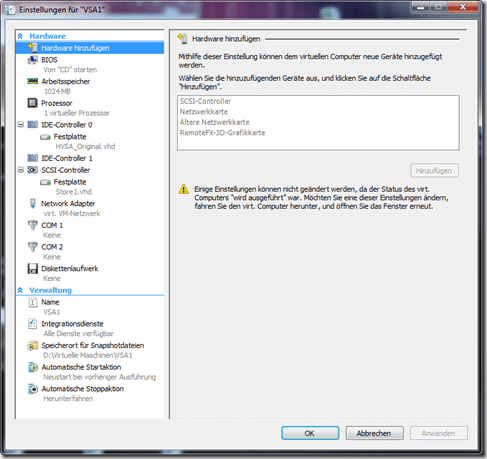

Die Eigenschaften der virtuellen Maschine sehen wie folgt aus

Die einzige Änderung hier sollte bei “Automatische Startaktion” gemacht werden und auf “Virtuelle Maschine immer automatisch einschalten” gestellt werden, damit die virtuelle Maschine auch wirklich immer eingeschaltet wird. Später bei der Konfiguration kann noch eine oder mehrere Netzwerkkarten hinzugefügt werden, je nach Bedarf und Netzwerkaufbau. Wir man erkennt, wird bei der (Linux-)Maschine ein “richtiger” Netzwerk-Adapter genutzt. Dies ist möglich durch die installierten und aktivierten Integrationskomponenten, ebenso ist ein Herunterfahren “von außen” möglich.

Die Verwaltung mit der Centralized Management Console

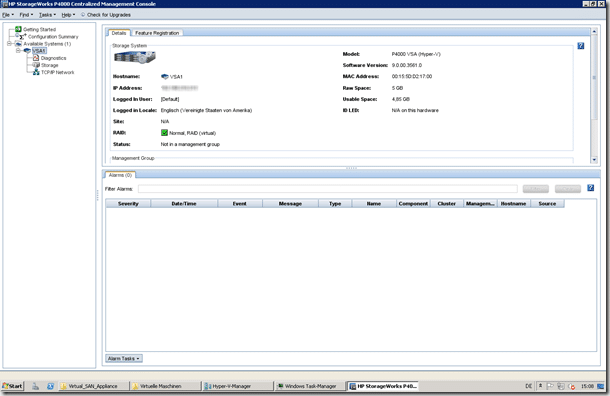

Nachdem die Maschine installiert ist, kann man an der Konsole nur noch wenig einstellen. Den Großteil der Konfiguration stellt man in der Management-Konsole ein.

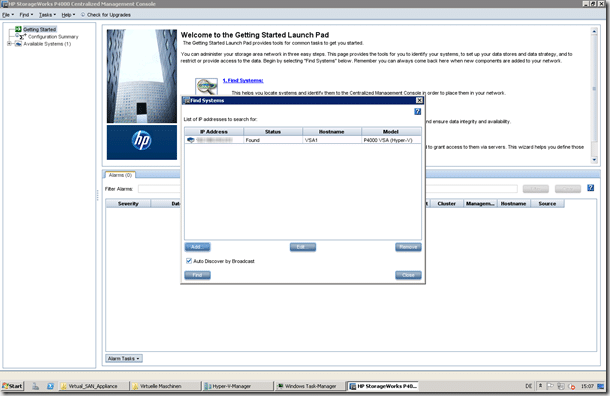

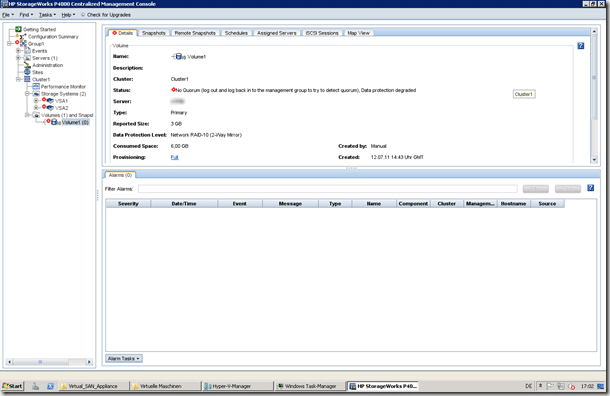

Als erstes wird das System über den Menüpunkt “Find” hinzugefügt

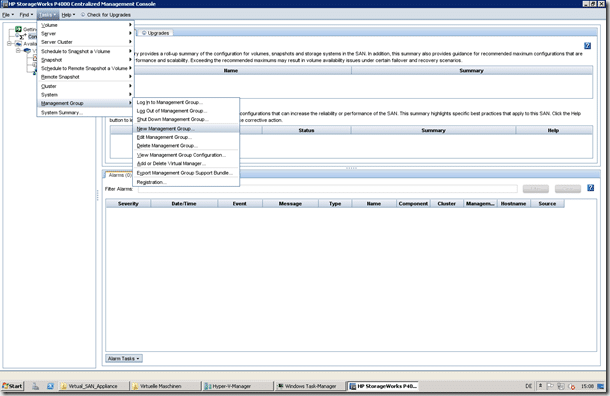

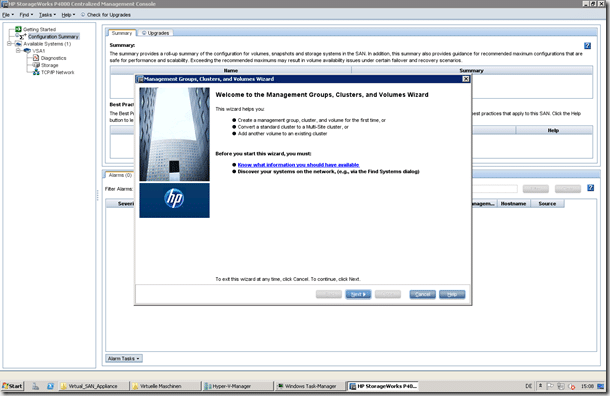

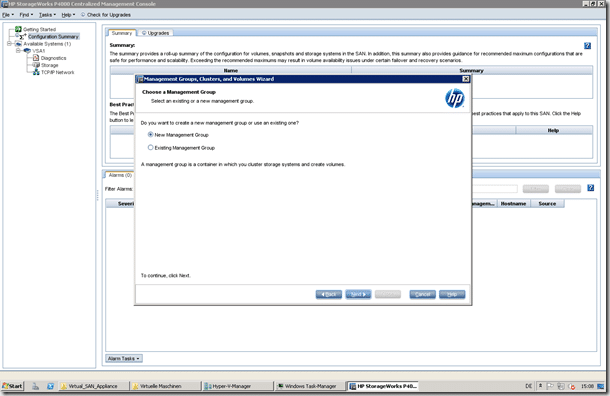

Die verfügbaren Systeme können (und müssen) in Management-Gruppen sortiert werden. Als erstes muss solch eine Gruppe erstellt werden

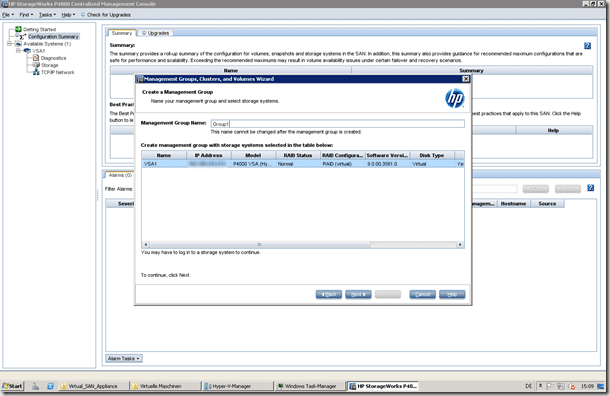

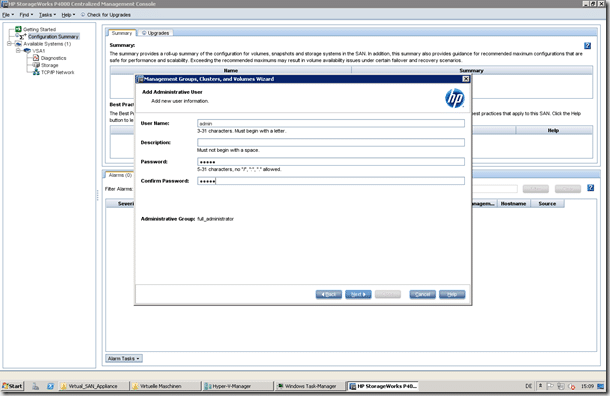

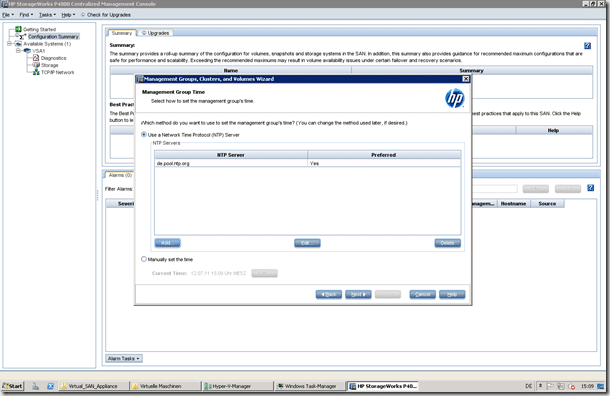

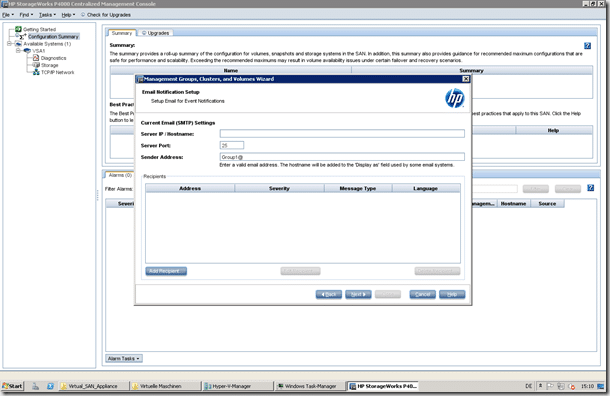

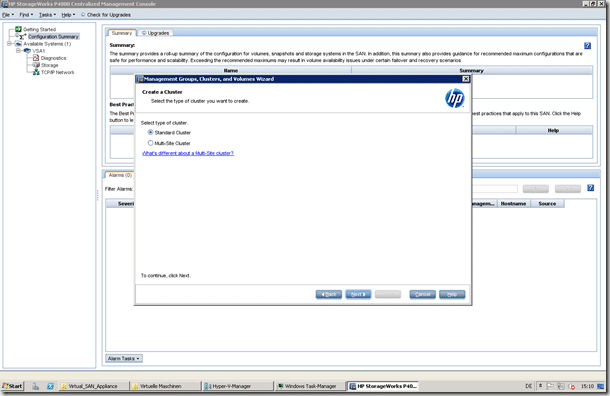

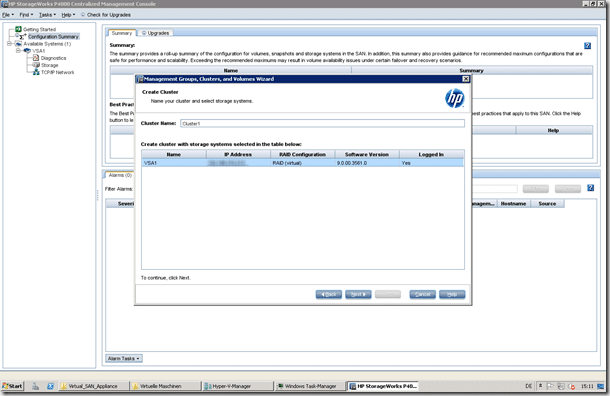

Hier eine kurze Zusammenfassung der Screenshot-Reihe:

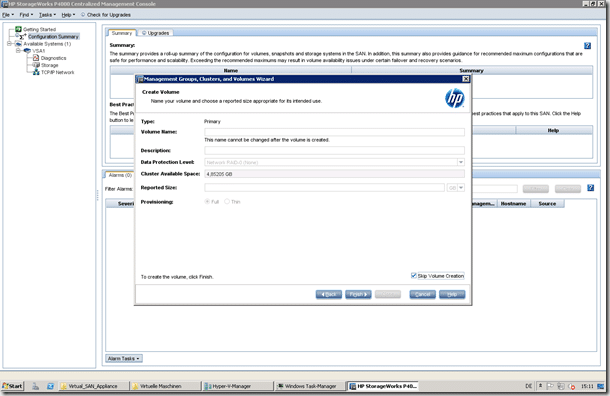

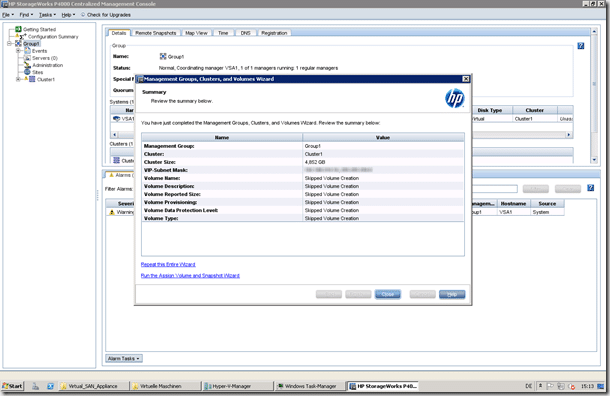

Es wird eine neue Management-Gruppe erstellt. In diese Gruppe wird das System “VSA1” automatisch aufgenommen. Die Gruppe wird mit einem Benutzernamen und einem Kennwort versehen, weiterhin wird ein Zeitserver sowie die DNS-Namen und –Server definiert. Als nächstes wird ein Mailserver und ein ein/mehrere Empfänger definiert, die wahlweise Fehlermeldungen, Warnungen und/oder Informationen zu dem System bekommen. Es wird gefragt ob es ein Standard- oder ein Multi-Site-Cluster werden soll, weiterhin wird der Name und die gemeinsame IP des Clusters abgefragt. Man kann im Zuge der Erstellung auch direkt ein Volume erstellen, diesen Schritt überspringen wir allerdings durch das Setzen der Option “Skip Volume Creation”. Am Ende bekommt man eine Zusammenfassung der Einstellungen und die Management-Gruppe mitsamt Cluster ist eingerichtet.

Hinzufügen eines weiteren Systems

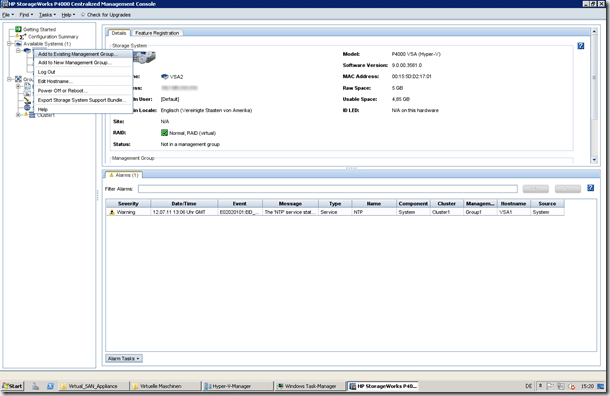

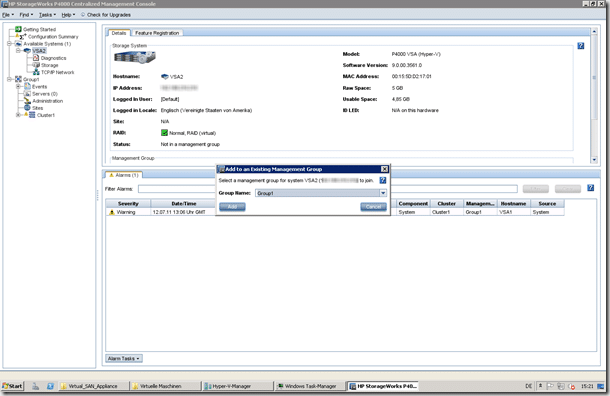

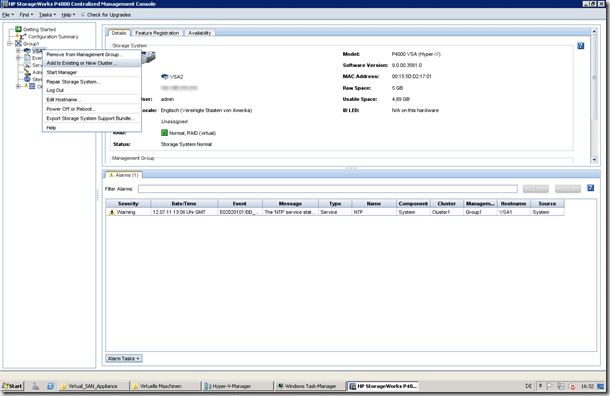

Als nächsten Schritt habe ich eine weitere Maschine mit der VSA-Software installiert und in der Management Konsole hinzugefügt. Sobald die Software das System findet kann man den Server einer bestehenden Management-Gruppe hinzufügen.

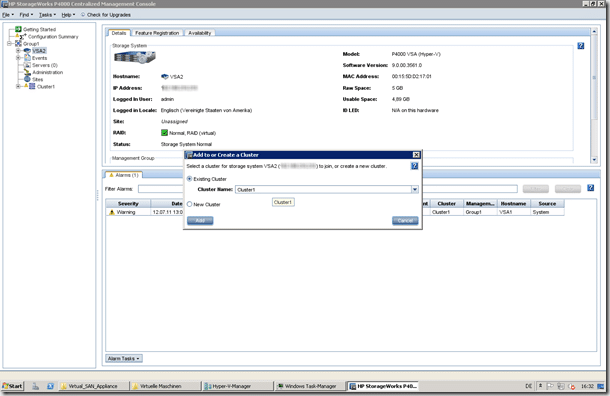

Nun kann das System einem Cluster hinzugefügt werden, alternativ könnte ein weiteres Cluster erzeugt werden

Erstellung eines Volumes zur Nutzung auf einem anderen Server

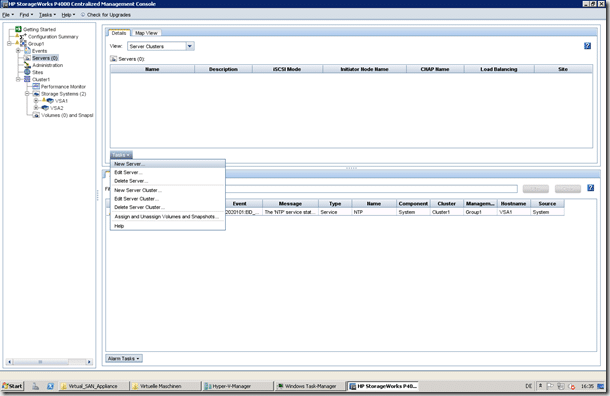

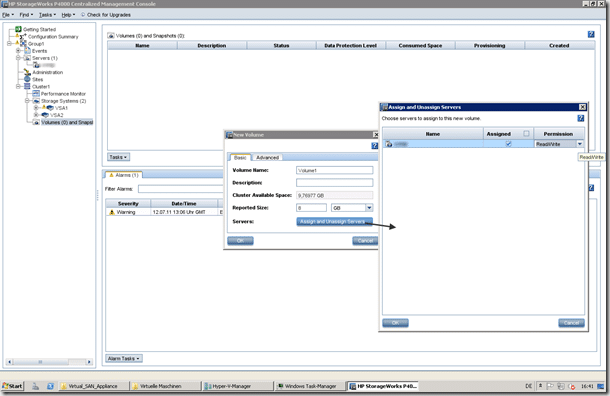

Als nächstes legen wir unter “Servers” das System an, was auf das Volume zugreifen darf.

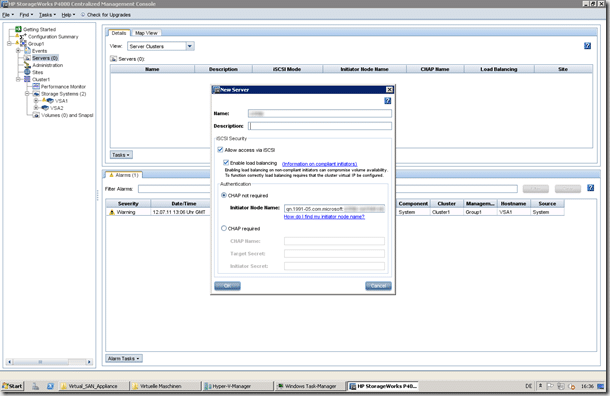

In dem folgenden Fenster wird der Name und der Initiator Node Name des Systems benötigt, alternativ kann die Verbindung auch per CHAP abgesichert werden.

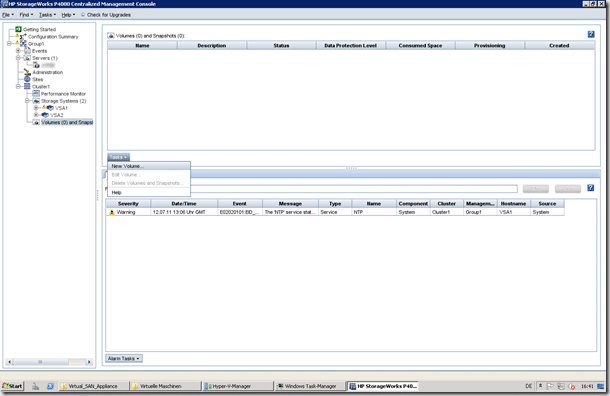

Danach beginnen wir mit der Erstellung des Volume

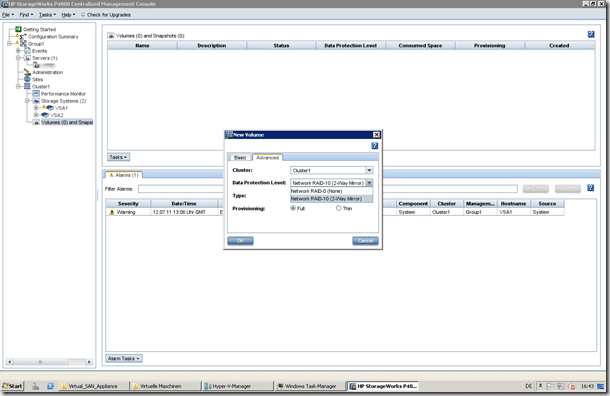

Im nachfolgenden Screenshot sieht man, das man die Wahl zwischen einem Network RAID-1 oder einem Network RAID-10 hat. Ich wähle Network RAID-10.

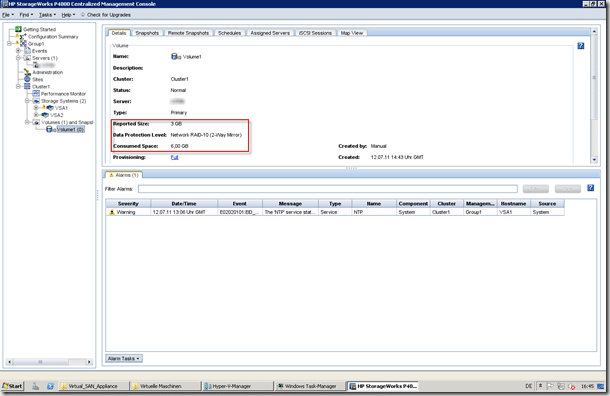

Man erkennt nach der Erstellung des Volumes, dass die angegebene Größe des Volumes doppelt gerechnet wird.

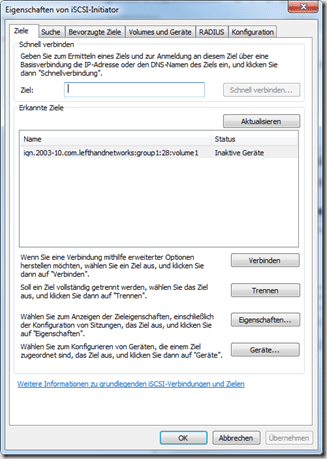

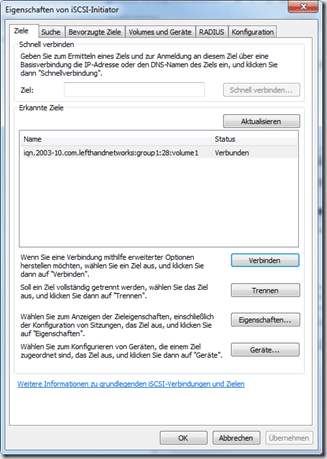

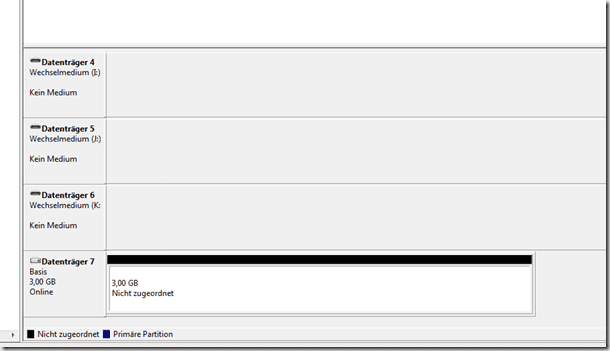

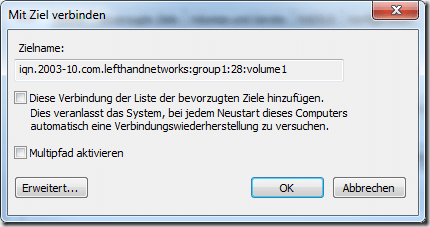

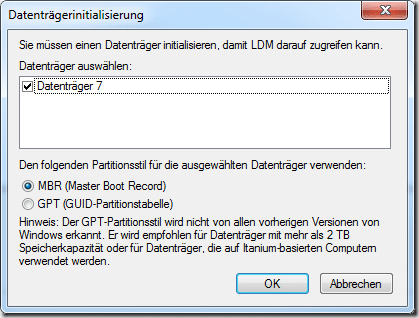

Die Anbindung an den Server ist recht einfach, im iSCSI-Initiator wird die während des Setup angegebene Cluster-IP angegeben und das Volume wird verbunden

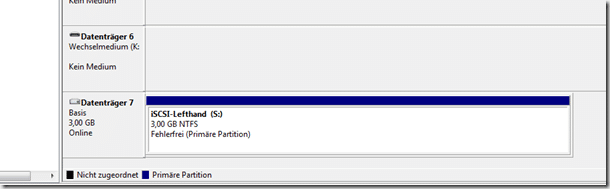

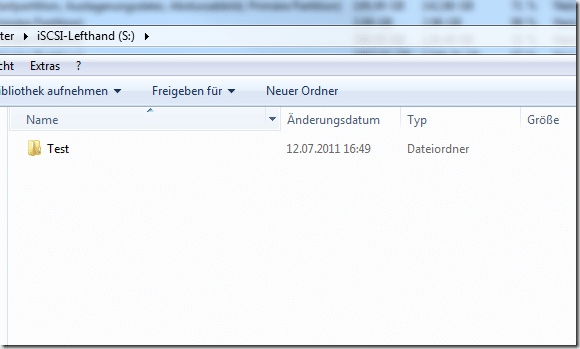

Wenn man nun eine der beiden VSA-Server herunterfährt, ist der Server mit dem Laufwerk S: trotzdem in der Lage, auf die Daten zuzugreifen. Hier zwei Screenshots der beiden Server, dem iSCSI-Initiator, dem offenen Laufwerk und der Management-Konsole:

Fazit

Die Software eignet sich super für die Erstellung eines SAN, vor allem wenn man die Hardware schon zur Verfügung hat und auf Grund von Infrastruktur-Änderungen diese zum Einsatz kommen kann. Bei dem Aufbau des SANs zählt natürlich die Geschwindigkeit und die Ausstattung der Hosts, auf denen die Daten liegen sollen, man kann hier nicht erwarten das die Software zaubert. Die Installation und Einrichtung der einzelnen Server funktioniert einfach und schnell, für einen sauberen und fehlerfreien Betrieb später sollte man sich allerdings die Software einige Zeit anschauen und in die Thematik einlesen, da man sonst Gefahr läuft unbewusst Fehler zu machen und mit bestimmten Konfigurationen in Fehler hineinläuft. Aber wo ist das nicht so… :)